政府與產業合作:如何在不阻礙創新的情況下使AI技術更安全

近年來,人工智慧(AI)技術的快速發展引發了廣泛的關注,尤其是在安全性和創新之間的平衡問題上。政府和產業如何合作,既能確保AI技術的安全,又不至於扼殺創新,已成為一個重要的課題。

政府層面的努力

– 美國:拜登政府於2023年10月發布了《關於安全、可靠和值得信賴的人工智慧的行政令》,旨在促進AI的安全和創新[2]。

– 加拿大:發布了開發和使用生成式人工智慧的自願行為準則,並推出了具有法律約束力的《自動決策指令》[2]。

– 中國:提出了《全球人工智慧治理倡議》,強調發展和安全並重,並通過《生成式人工智慧服務管理暫行辦法》等法規[3][4]。

– 各國積極參與國際峰會和合作,例如巴黎AI峰會,旨在建立包容而高效的AI國際治理框架[1][3]。

產業層面的貢獻

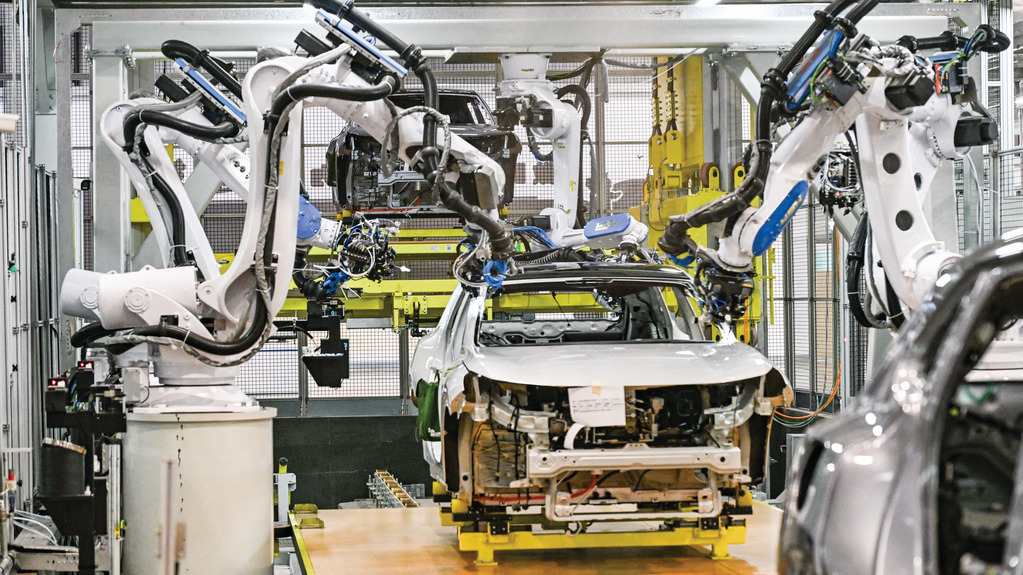

– 企業在AI安全技術的研發上投入大量資源,例如開發更安全的AI模型和算法[3]。

– 產業內部的合作與知識共享對於AI安全的提升至關重要,許多企業成立了AI安全研究所以推動相關研究[2][4]。

政府與產業的合作模式

– 新加坡資訊通信媒體發展局與Human Intelligence合作進行AI安全紅隊演練,模擬惡意攻擊以發現AI系統的漏洞[1]。

– 新加坡資訊通信媒體發展局與AI Verify基金會聯合推出試點項目,匯集全球AI安全測試供應商,制定AI安全標準[1]。

– 與日本合作在多種語言環境中進行大型語言模型安全測試,促進AI在不同文化背景下的安全應用[1]。

結論

政府和產業的合作是確保AI技術安全與創新並重的關鍵。通過立法監管、技術創新、國際合作等多方面的努力,可以有效地平衡AI的安全性和創新潛力,促進AI技術的健康發展。未來,各國應繼續加強合作,共同推動AI安全治理的進步。